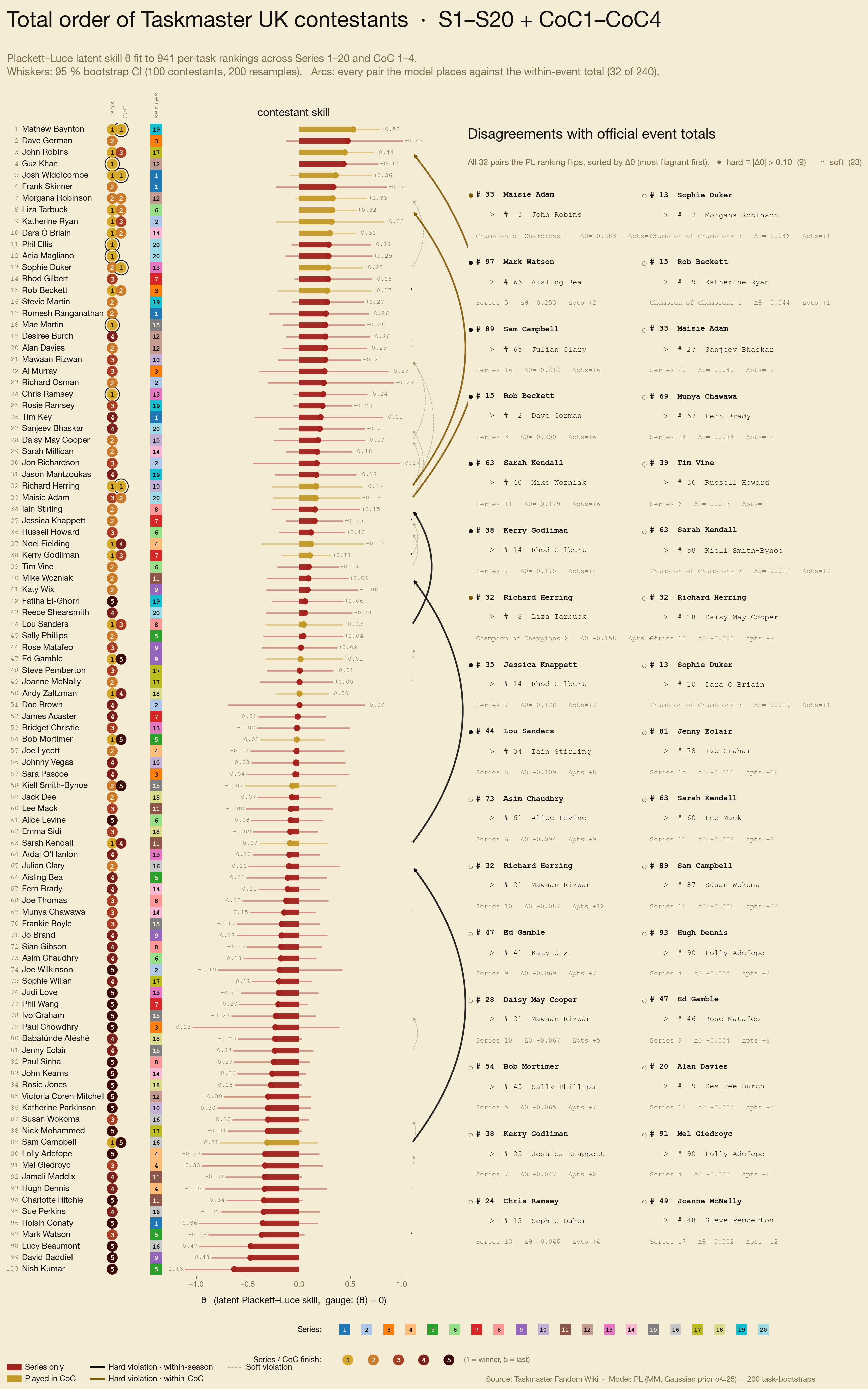

TL;DR – Verwendete Plackett-Luce für jede Rangliste pro Aufgabe, um alle 100 britischen Taskmaster-Teilnehmer auf einer einzigen Fähigkeitsskala zu platzieren, mit Bootstrap-CIs und einer Zählung jedes Paares, bei dem das Modell nicht mit den offiziellen Gesamtwerten übereinstimmt.

Hintergrund. Zuchtmeister (UK, Channel 4, 2015–) ist eine Comedy-Gameshow, in der fünf Komiker pro Serie in etwa 50 absurden Aufgaben gegeneinander antreten ("Essen Sie so viel Wassermelone wie möglich, während Sie einen Imkeranzug tragen", "Backen Sie einen traurigen Kuchen für einen Fremden"usw.). Jede Aufgabe wird im Nachhinein vom Taskmaster (Greg Davies) beurteilt, der 1–5 Punkte pro Teilnehmer vergibt. Nach 20 Serien gab es 100 Teilnehmer plus vier "Champion der Champions" Specials (CoC), bei denen die fünf Gewinner aller fünf Staffeln in einer Miniserie mit einer Episode gegeneinander antreten.

Das Problem. Innerhalb einer Serie haben wir eine vollständige Rangliste, aber nichts sagt uns, wie wir die Teilnehmer zwischen den Serien vergleichen sollen. Die vier CoCs geben ein kleines bisschen Informationen zwischen den Serien, aber nur lokal – jedes CoC verbindet nur fünf aufeinanderfolgende Staffeln (CoC1: S1–5, CoC2: S6–10 usw.) und im Grunde gibt es keine Teilnehmerwiederholungen zwischen den CoCs. Die offensichtliche rohe Gewalt (innerhalb jeder Saison normalisieren und dann mit CoCs zusammenfügen) hinterlässt drei additive Konstanten zwischen den vier Clustern, die einfach nicht identifizierbar sind: Man kann buchstäblich nicht sagen, ob der S1–5-Cluster auf der globalen Skala über oder unter dem S16–20-Cluster liegt.

Offensichtlich falsche, aber unvermeidbare Annahmen:

- Gregs Punktzahlen pro Aufgabe spiegeln die tatsächliche Aufgabenkompetenz wider (keine Stimmung, Bevorzugung oder Running Gags).

- Der Schwierigkeitsgrad der Aufgabe ist im Durchschnitt für alle gleich.

und viele mehr.

Das Modell. Nachdem ich eine Menge Dinge ausprobiert hatte (KL-Abstände bei Ranghistogrammen, L2 bei Trajektorien pro Serie, handgefertigte Funktionen + Regressor, Bradley-Terry bei aggregierten Siegen), war die natürliche Antwort: Plackett-Luce:

Jeder Teilnehmer erhält eine latente Fähigkeit θ. Bei jeder Aufgabe wird die realisierte Reihenfolge durch sequentielles Softmax ermittelt – der erste Platz ist

exp(θᵢ) / Σⱼ exp(θⱼ)dann das Gleiche über die Überlebenden usw. Multiplizieren Sie über alle ~940 Aufgaben, maximieren Sie.

Warum es hier das richtige Tool ist:

- Die Beweiseinheit ist eine Rangliste pro Aufgabe, keine Saisongesamtsumme → ~940 Beobachtungen statt ~24.

- Keine Schuppennaht erforderlich. PL verfügt über ein einziges globales Additivmessgerät; Durch die vier CoCs ist das Vergleichbarkeitsdiagramm verbunden, sodass ein eindeutiger MLE vorliegt.

- Krawatten werden sauber gehandhabt (Summe über konsistente strenge Reihenfolgen).

- Konvexe/einfache MM-Iteration, läuft in 0,1 s auf einem Laptop.

- Bootstrap auf Aufgabenebene liefert CIs.

- PL verwendet nur die Befehl der Punktzahlen, nicht der Größenordnungen, was das mildert "Greg ist kalibriert" Annahme ein wenig.

Die Figur. 100 Teilnehmer nach θ geordnet, 95 % Bootstrap-CIs (200 Aufgaben-Resamples). Jeder Teilnehmer trägt Chips für sein Event-Finish (1 = Gewinner, 5 = Letzter) und ein farbiges Quadrat für seine Saison. Bögen markieren alle Paar-PL-Flips im Vergleich zur offiziellen Gesamtzahl innerhalb des Events – 32 von 240 Paaren (~13 %), davon 9 "hart" (|Δθ| > 0,10) und 23 sind "weich".

Einige Erkenntnisse:

- Nur Mathew Baynton, John Robins, Liza Tarbuck und Dara Ó Briain haben niedrigere CIs deutlich über 0 – die einzigen Teilnehmer, die souverän über dem Durchschnitt liegen.

- Lucy Beaumont, David Baddiel und Nish Kumar sind die einzigen mit oberen CIs unter 0 – deutlich unter dem Durchschnitt.

- Die meisten anderen Top-30-Paare sind statistisch nicht zu unterscheiden; Die Befehl macht Spaß, ist aber nicht eindeutig.

- Bei schweren Verstößen handelt es sich fast ausschließlich um offizielle Abweichungen von 1–2 Punkten, bei denen PL in der anderen Richtung stärkere Belege pro Aufgabe hat.

Werkzeuge. Python (NumPy, Pandas, Matplotlib). Daten aus dem Taskmaster Fandom Wiki und öffentlichen Git-Repos.

Von dhsilver

5 Kommentare

**Data:** Mostly from the [Taskmaster Fandom Wiki](https://taskmaster.fandom.com/) — every per-task score for Series 1–20 and Champion of Champions 1–4 (~940 tasks, ~4,500 contestant-task scored rows). Cross-checked against a few existing GitHub Taskmaster datasets (e.g. `tdlm.fly.dev`’s tables) to catch parsing bugs. NYT specials excluded (too short, badly connected to the rest).

**Model:** global Plackett–Luce, fit with weighted Hunter MM (mild Gaussian prior σ²=25 on θ for stability). Tied scores expanded into the average over all consistent strict orderings. 95% CIs from 200 task-resample bootstraps.

**Tools:** Python — NumPy / pandas / SciPy for the model + bootstrap, Matplotlib for the figure. The MM step is vectorised over a padded `(R, L_max)` ranking matrix, so the full fit + bootstrap takes ~25 s on a laptop.

Love the attempt, an amazing show.

Did you normalize for the well known fact that Greg has been far more generous with points in later seasons VS earlier ones? That would persistently depress the first 5 seasons (and first coc series), leaving all contestants lower than they should be. I think it was nearly season 10 before he got as generous as he is now.

Your system puts Bob mortimer far too low, so I can’t accept it. Try again.

All just fun and games of course. Great show, fun attempt to do a fair comparison.

this is super cool but my favorite being ranked low means the model is clearly flawed

John Robins would lap this up

Looking at the cellar-dwellers, it seems that being a bubbly, positive personality is a drag on being effective at TM