Ich habe die 5.000 GitHub-Repositories mit den meisten Sternen von 2019 bis 2025 analysiert, um herauszufinden, ob KI-Tools tatsächlich die Art und Weise verändert haben, wie wir Codedokumentation schreiben. Die Antwort ist Ja. Hier sind die wichtigsten Erkenntnisse aus 35.000 erstklassigen Repos:

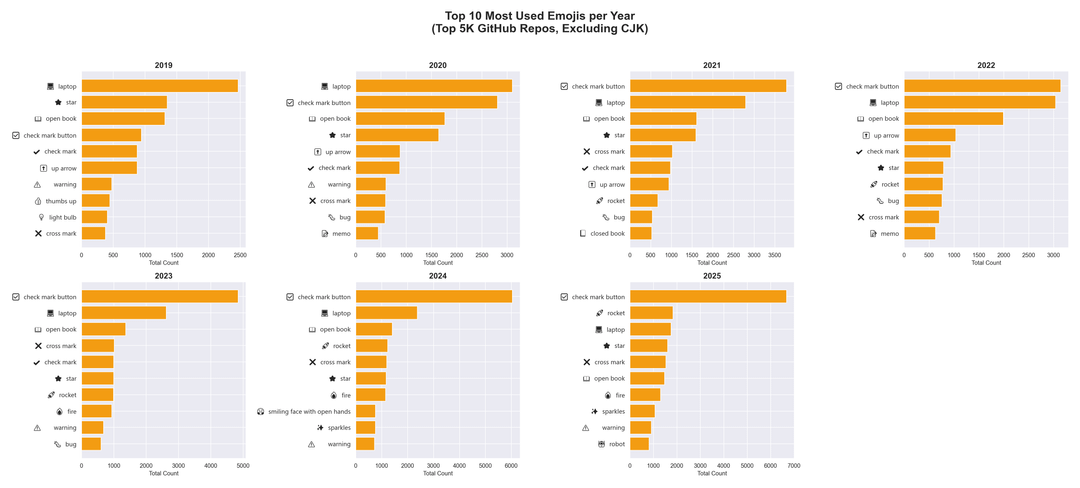

Der "Funkelt" Epoche

Die beliebtesten Emojis vor KI (2019–2021) waren nützlich: 💻, ⭐, ⚠️. Im Jahr 2024 sind die Rakete (🚀) und die Glitzer (✨) vollständig zum Markenzeichen des KI-Hypes geworden.

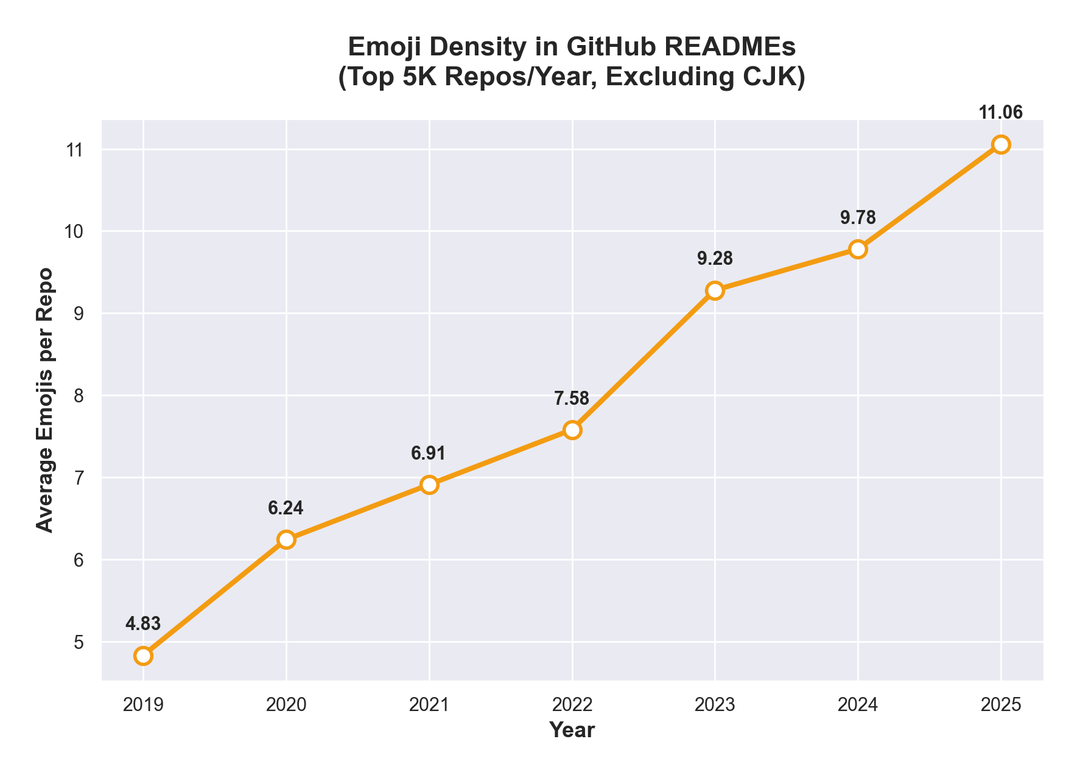

Emojis sind überall

Die Emoji-Dichte stieg um 130 %. KI-Modelle formatieren Listen standardmäßig mit Emojis, wodurch der Durchschnitt von 4,8 Emojis pro Repo auf über 11 sinkt.

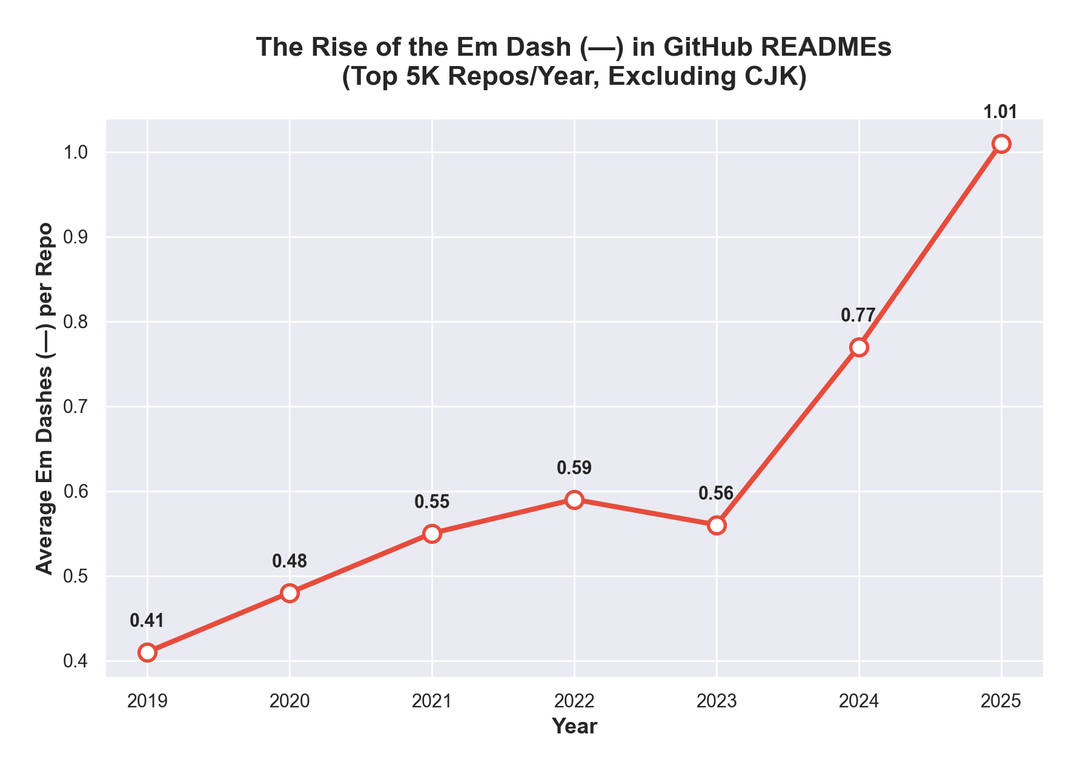

Der "Em Dash" Explosion

Generative KI liebt das "em Dash" (—). Im Jahr 2019 verwendete das durchschnittliche Repo 0,41 Striche. Bis 2025 stieg dieser Wert sprunghaft auf 1,01 (ein Anstieg um 146 %).

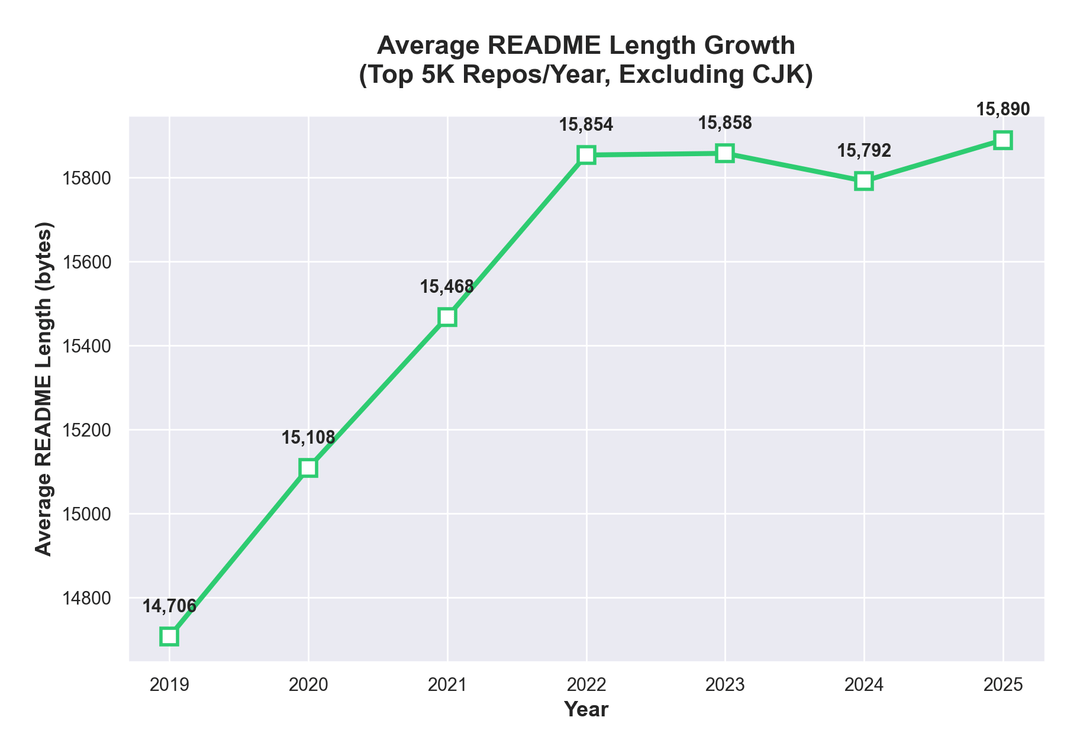

Aufblähen

Die Erstellung einer kompletten Einrichtungsanleitung dauert jetzt 5 Sekunden. Aus diesem Grund wuchs die durchschnittliche README-Größe um etwa 1.000 Byte (8 %).

Methodik

Die Daten stammen aus Google BigQuery (identifiziert jedes Jahr die 5.000 Repos mit den meisten Sternen) und wurden mithilfe eines Python-Skripts analysiert, das genau 35.000 HTTP-Anfragen an gesendet hat raw.githubusercontent.com.

Vollständiger Bericht: https://medium.com/@srkorwho/i-analyzed-35-000-github-readmes-to-see-if-ai-changed-how-we-write-code-documentation-6e8715a4f43c

Von Mean-Sink6996

6 Kommentare

Nice overview, just one criticism: your first graph really suffers from the Y-axis truncation. It’s fine for the other graphs, as the ordinate displays a reasonable value range, but for the first one it makes it seem like a very small (<10%) difference is substantial.

How did you come to that emoji conclusion? Pre-LLM emoji usage trendline seems to agree with the increase in usage.

Cool data, it’s really interesting that a lot of these trends were in place, pre-LLM explosion, and LLMs just accelerated them.

However I don’t agree with this interpretation:

> It now takes 5 seconds to generate an entire setup guide. Because of this, the average README size grew by ~1,000 bytes (8%).

LLMs weren’t really being used for README generation widely until 2023 and onward. If anything, we see that there was already a trend of increasing README lengths prior to the introduction of LLMs and LLMs actually halted this.

Curious what data looks like before 2019. Is it relatively stable and thus not really worth showing?

Y axis range is 14800 to 158000. Just a 1000 byte difference. I think the difference is explained by heavy use of emoji?

GPTs are statistical models so it’s unlikely go over or below pre AI era average README lengths unless specifically prompted to do so by a human.

LLM produced READMEs are way to verbose and unreadable in my opinion. Better than empty READMEs I guess.