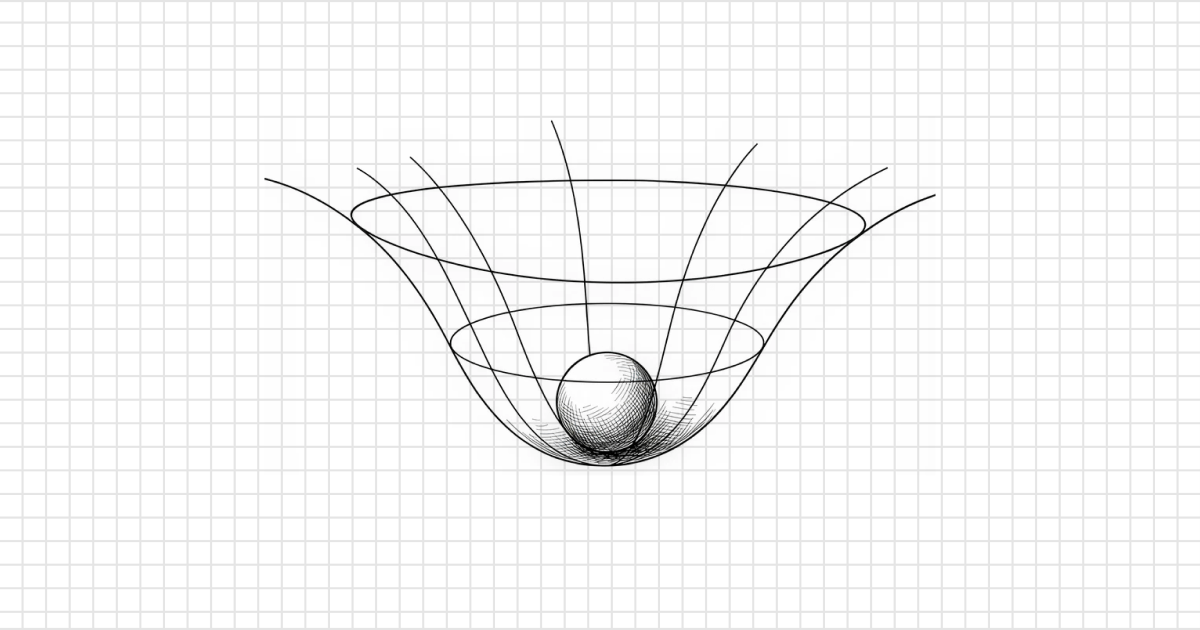

Wir haben gesehen, dass KI gut darin ist, plausiblen Text und Code zu generieren. Die nächste Grenze könnte, wie einige Forscher wie Yann LeCun argumentieren, eine vertrauenswürdige KI sein. Er ist an einem Startup beteiligt, auf das gewettet wird "Energiebasierte Modelle" die für korrekte, konsistente Antworten und nicht nur für fließende Antworten optimiert sind.

Parallel dazu gibt es einen Drang nach Codierung von KI Systeme, die mathematische Beweise verwenden, um 100 % Genauigkeit in kritischer Software sicherzustellen. Es fühlt sich an, als würde sich die Erzählung verschieben "KI, die schafft" Zu "KI, die zuverlässig argumentiert". Ist dies der notwendige Schritt, bevor wir KI wirklich in anspruchsvollen realen Anwendungen einsetzen können?

After the LLM revolution, the next AI shift might be toward "provably correct" reasoning.

byu/Possible-Ad4357 inFuturology

4 Kommentare

I very much enjoy the idea that ‚trustworthiness‘ comes *after* ‚ubiquity‘.

The ai only knows what we tell it. If we don’t know what the truth is, how are we going to train the ai on truthfulness.

„Provably correct reasoning“ is simply a weighted search tree.

Meh.

Show me irrational exuberance.

From “probably correct” to “provably correct” is a bigger step than just replacing a letter 😅