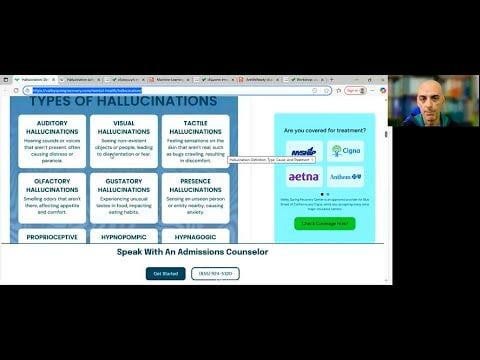

Eines der wichtigsten Probleme der modernen KI und insbesondere von Large Language Models (LLM) ist die "Halluzinationen" (Hallizinationen). Hierbei handelt es sich um die Produktion falscher oder nicht vorhandener Daten in den daraus resultierenden Ergebnissen, beispielsweise nicht vorhandene bibliografische Quellen und Autoren. Heute diskutieren wir über KI-Halluzinationen, worauf sie zurückzuführen sind, was sie in der Praxis bedeuten und welche Auswirkungen sie haben können, von leicht bis sehr schwerwiegend. Es handelt sich um ein Problem, das in den kommenden Jahren angegangen werden muss, wahrscheinlich zusammen mit der Notwendigkeit einer erklärbaren KI (xAI).

Reboot podcast (24-10-2025): Γιατί το ΑΙ έχει παραισθήσεις;

byu/xgeorgio_gr ingreece

Von xgeorgio_gr